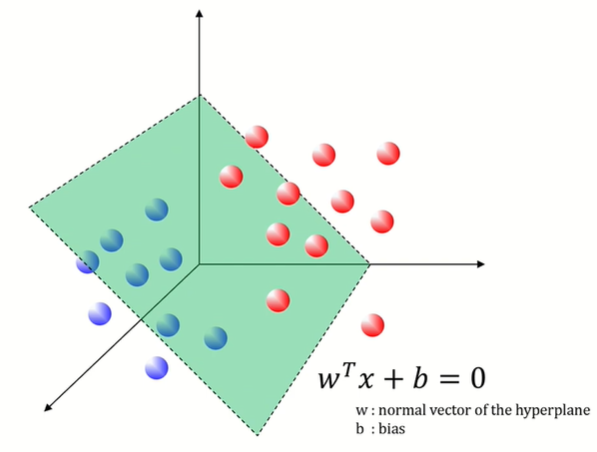

Support Vector Machine

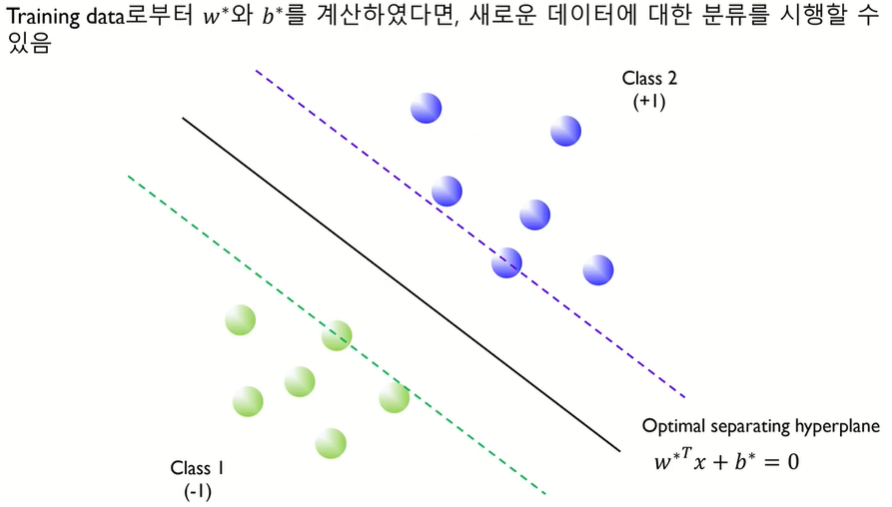

고차원 분류에 높은 성능

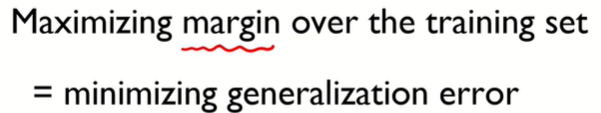

train error가 줄면 test error도 줄어드는 generalization ability가 좋음

margin을 최대화하면 test error는 최소화된다는 것

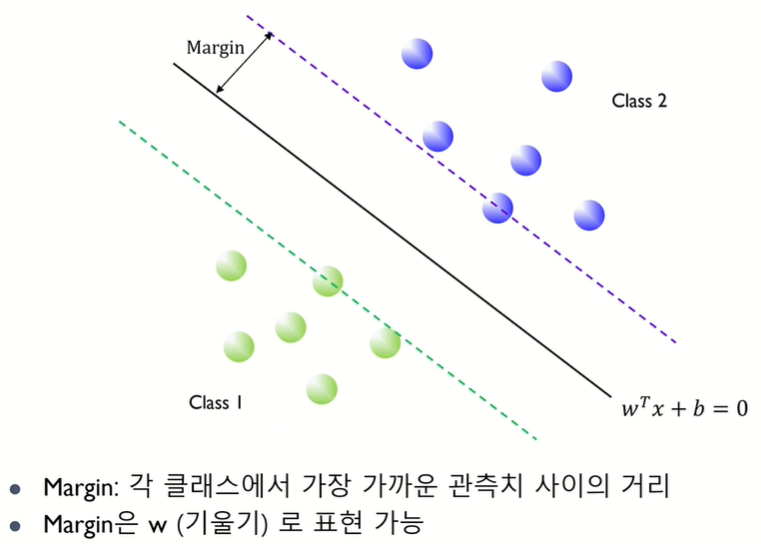

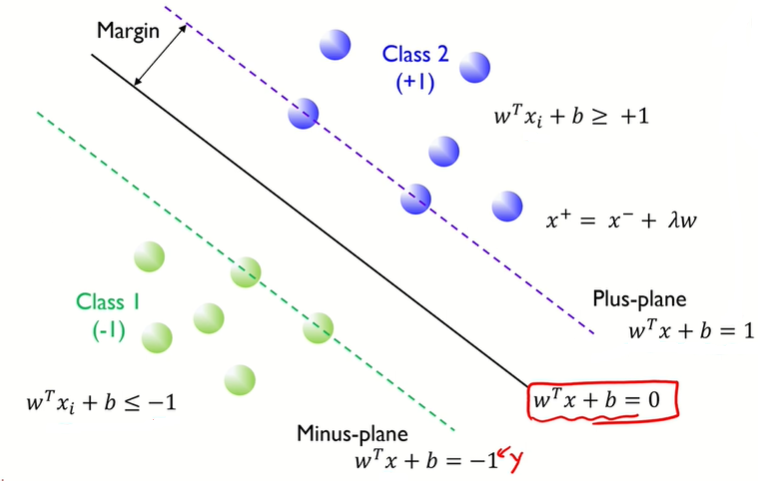

Margin

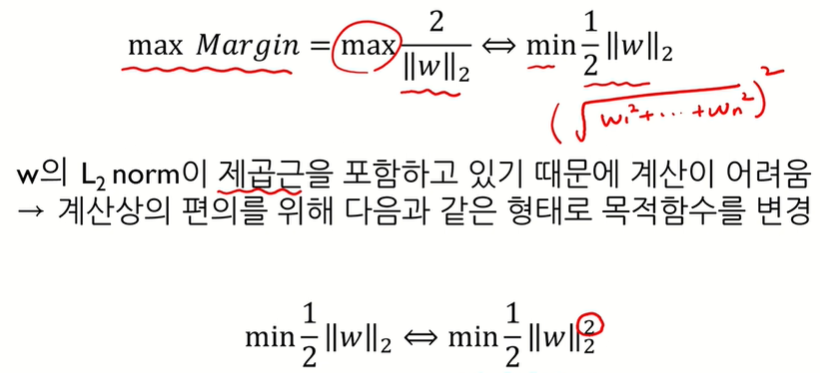

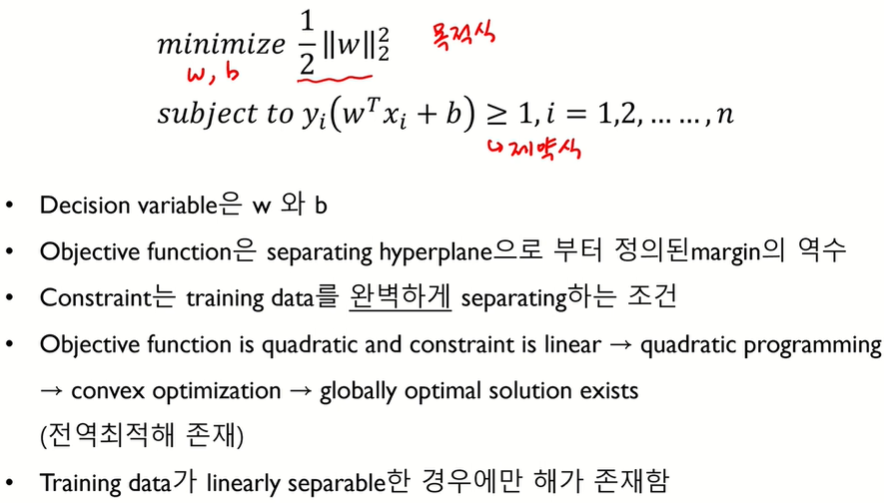

Margin을 w-norm으로 표현

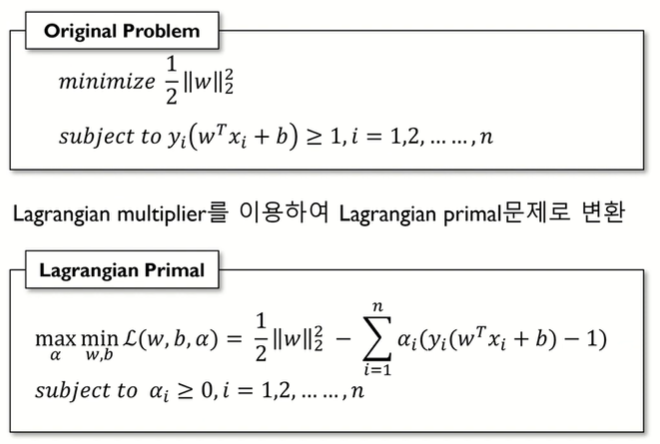

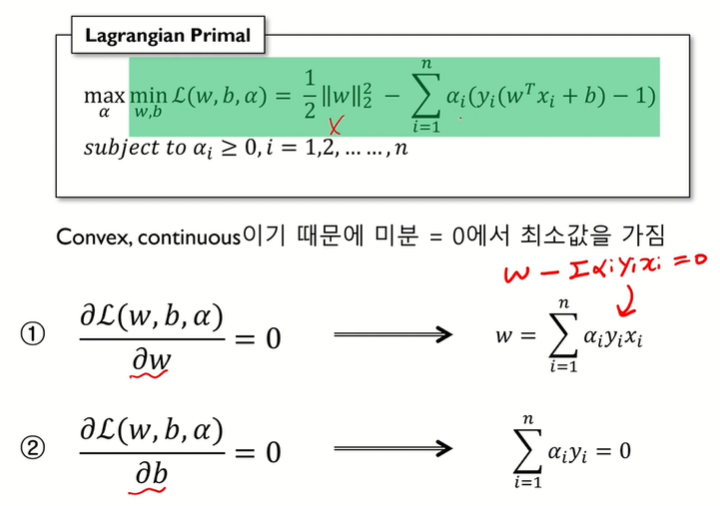

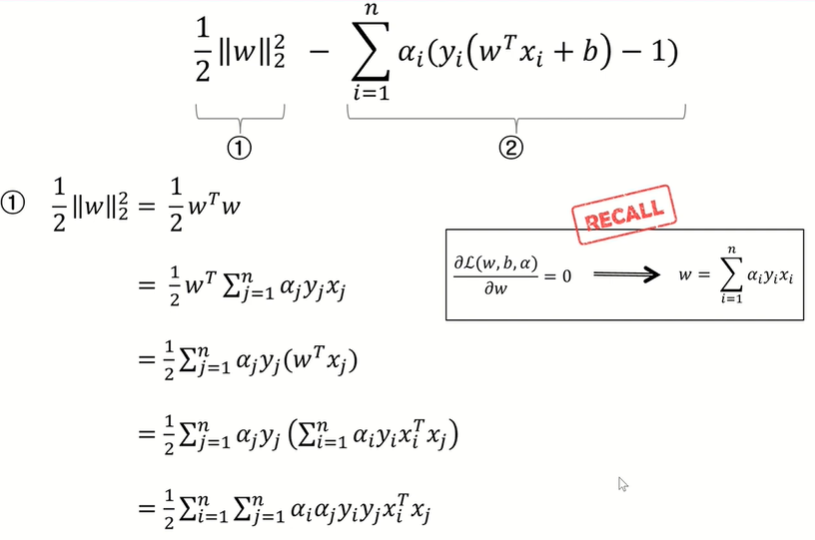

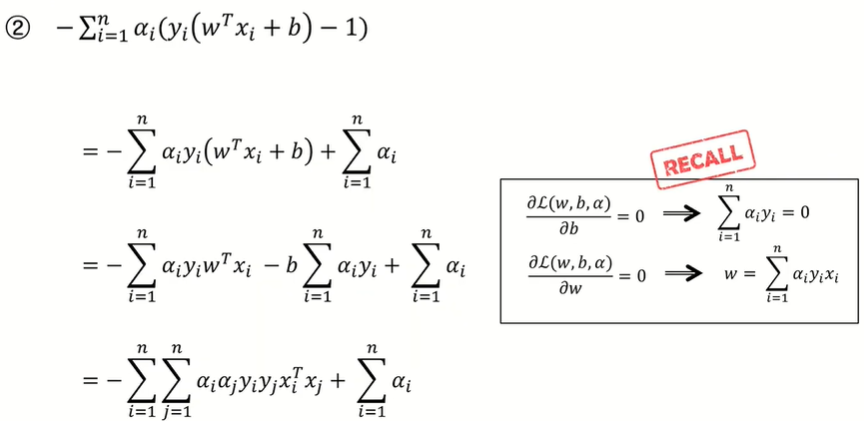

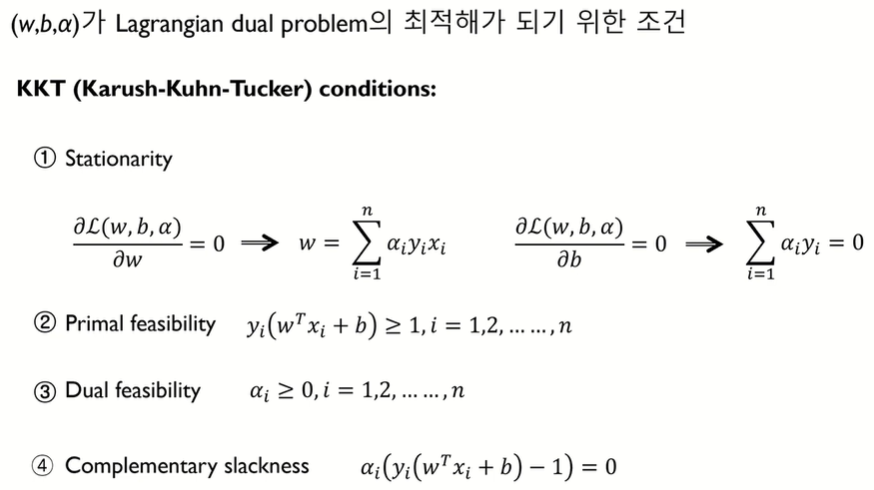

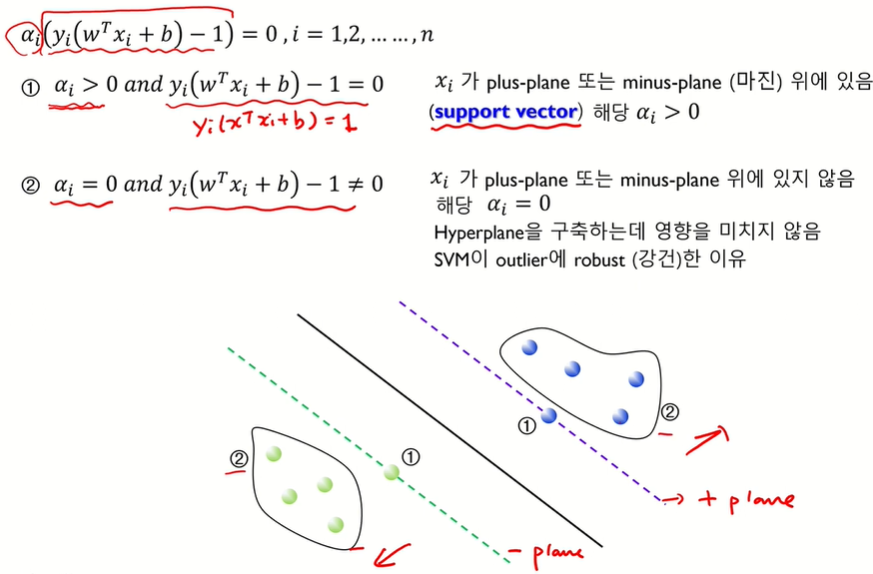

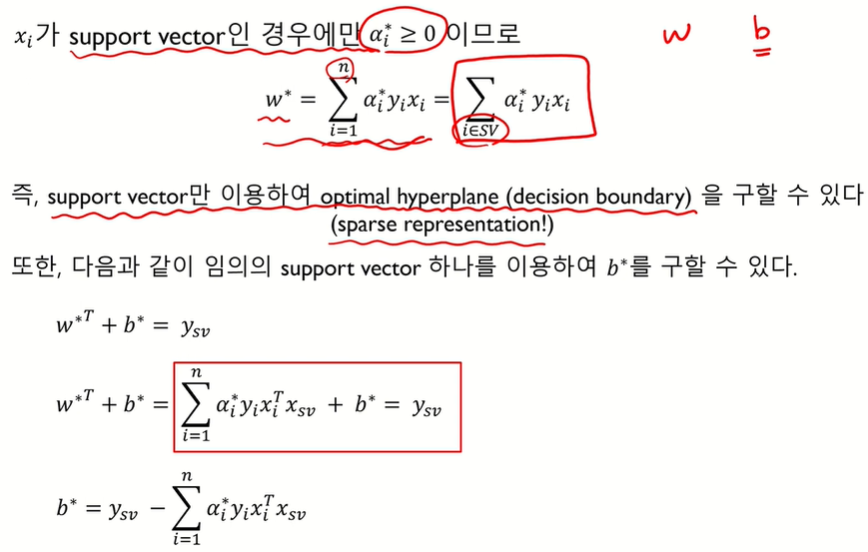

Lagrangian Formulation

목적식과 제약식을 합쳐서 표현

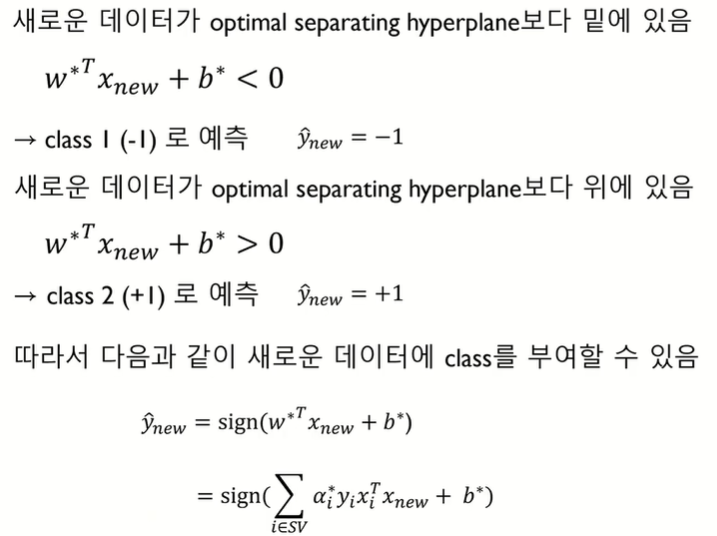

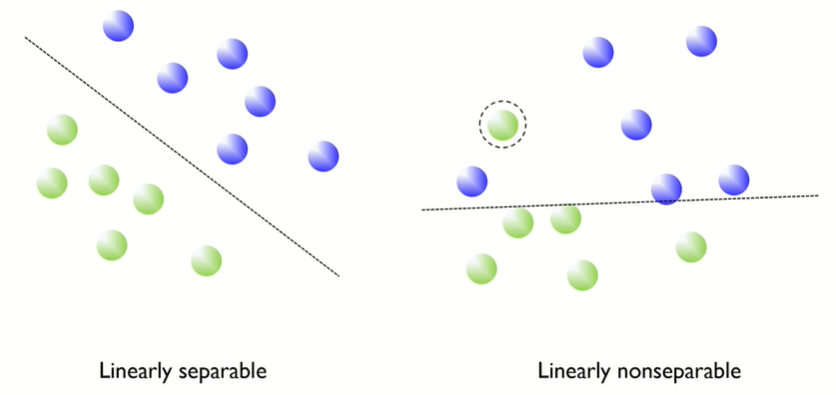

Hard Margin SVM : 선형으로 분리하는 SVM , Linearly Separable case

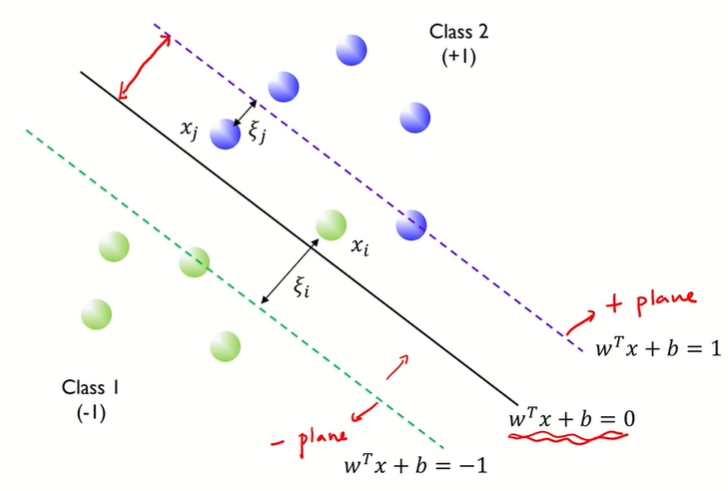

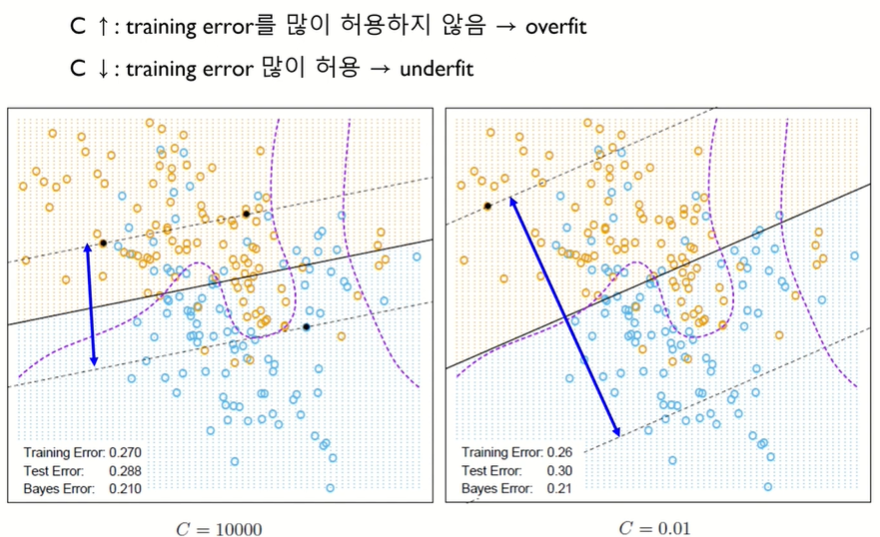

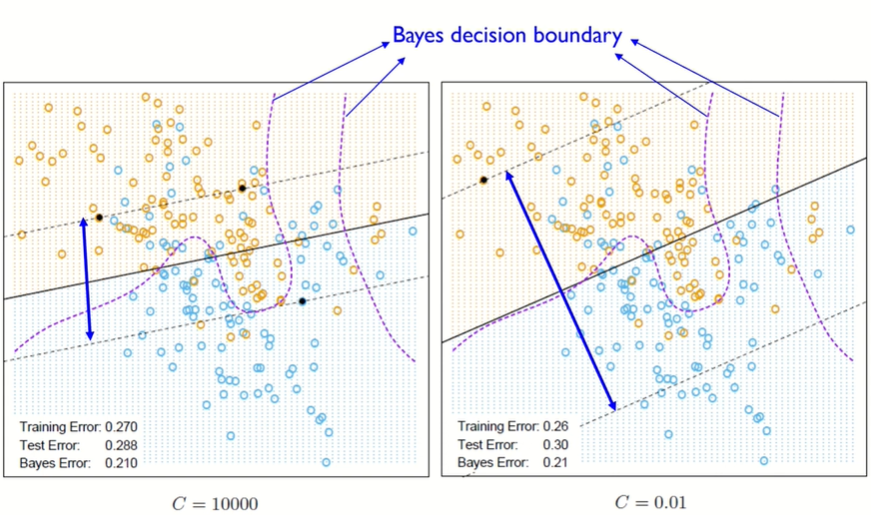

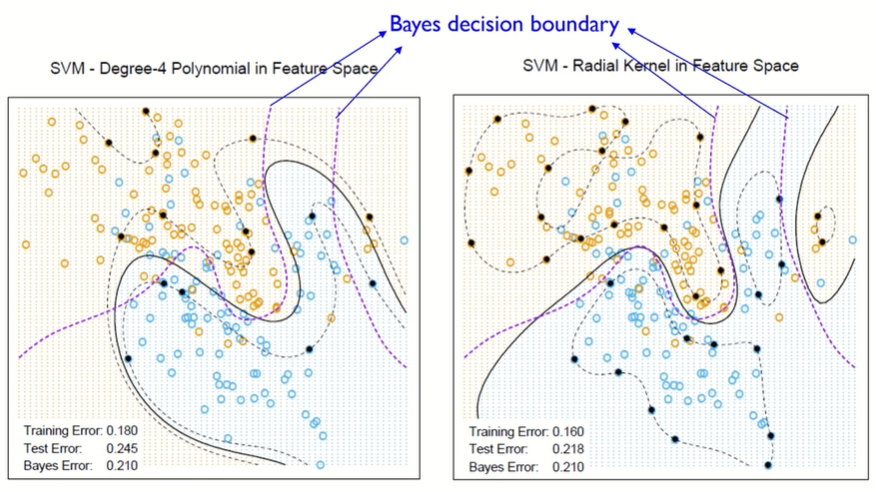

Soft Margin SVM : 선형으로 분리할 수 없는 SVM , Linearly Nonseparable case, 약간의 에러를 허용

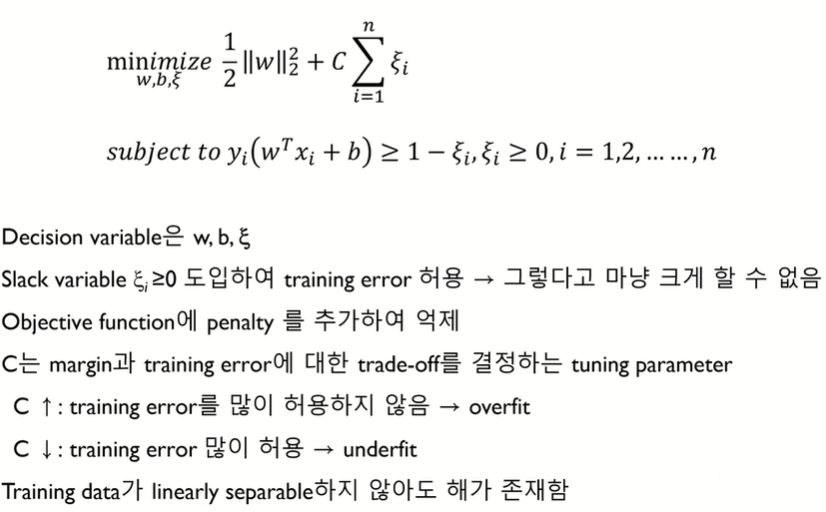

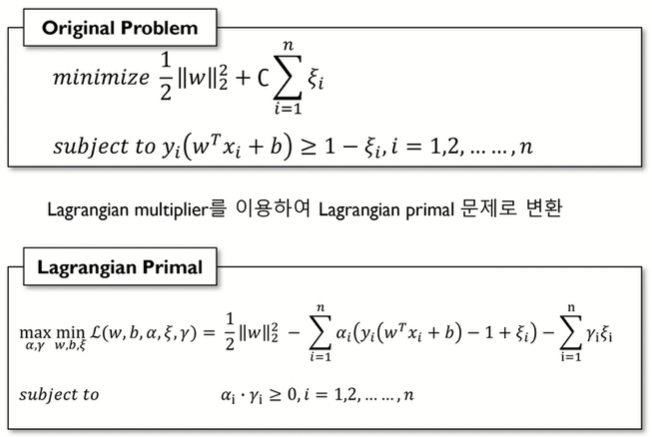

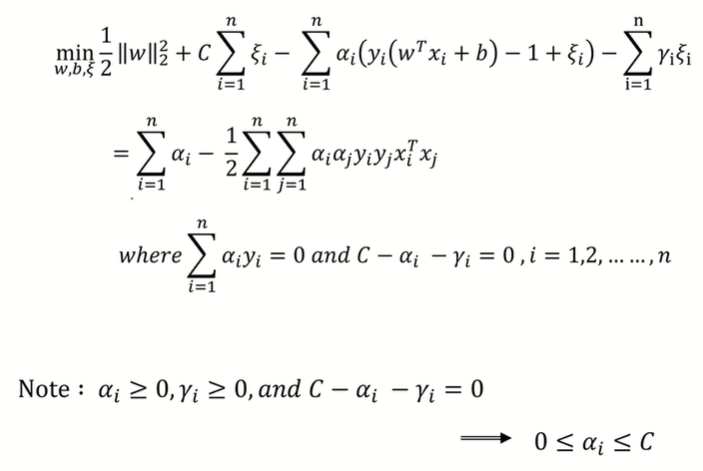

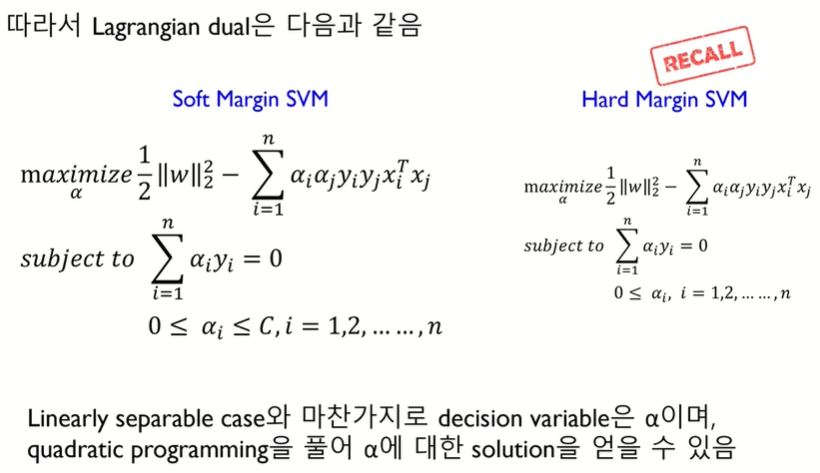

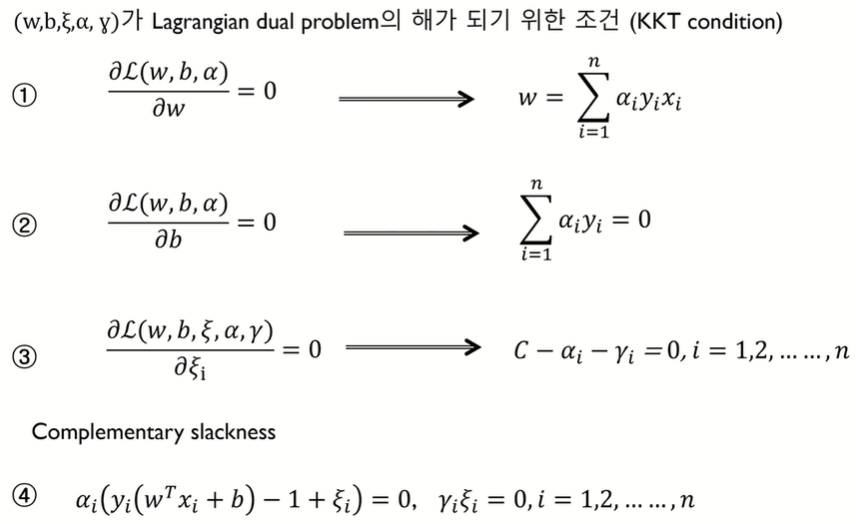

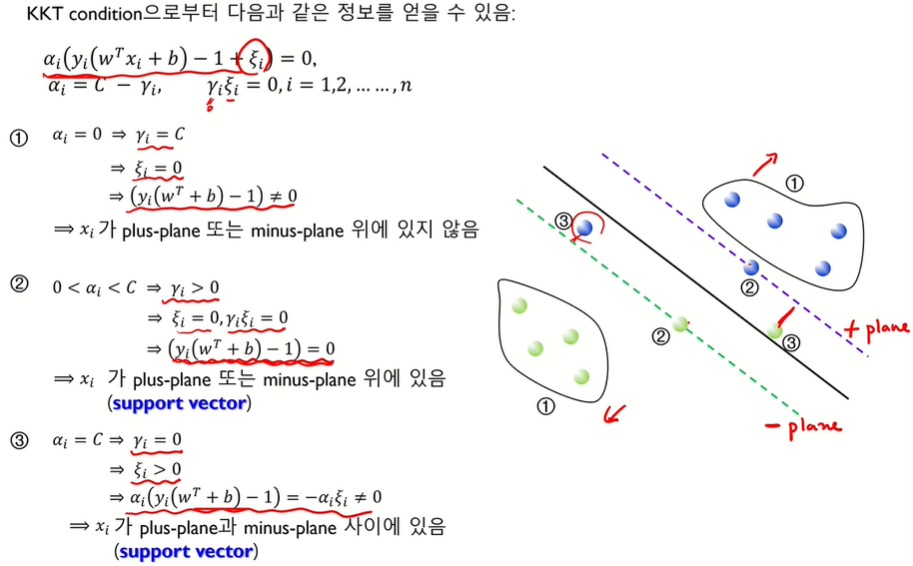

Soft Margin SVM

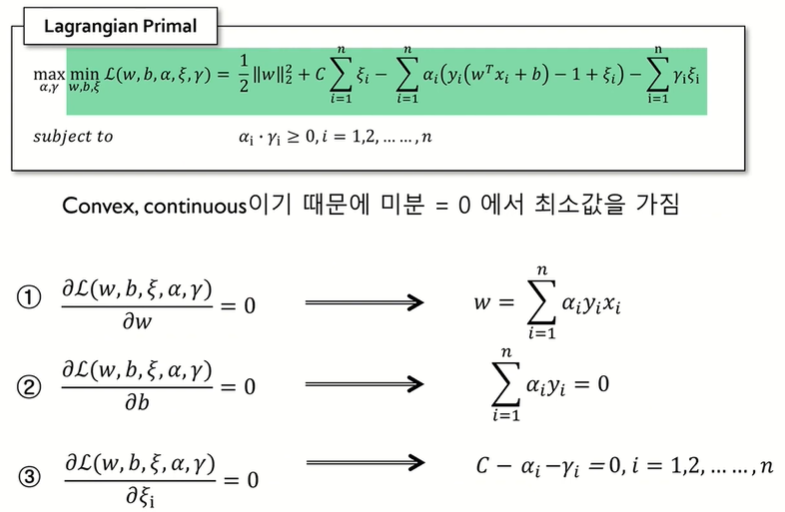

Lagrangian Fomulation

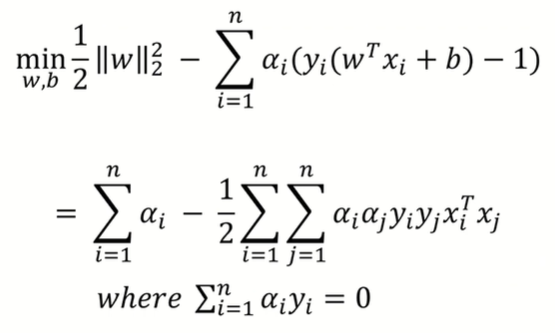

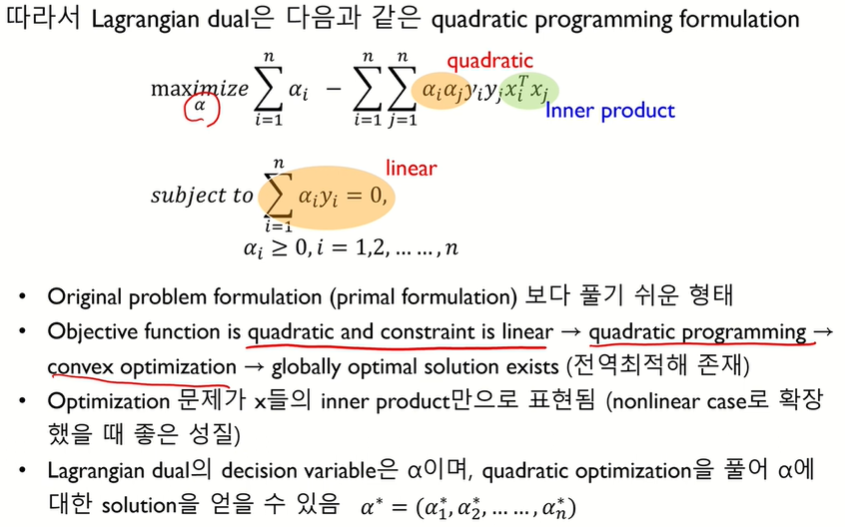

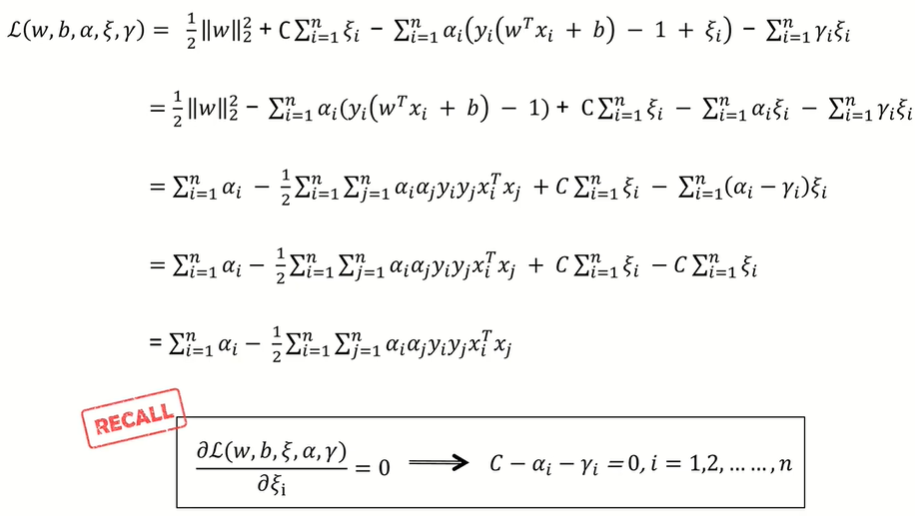

Lagrangian Dual

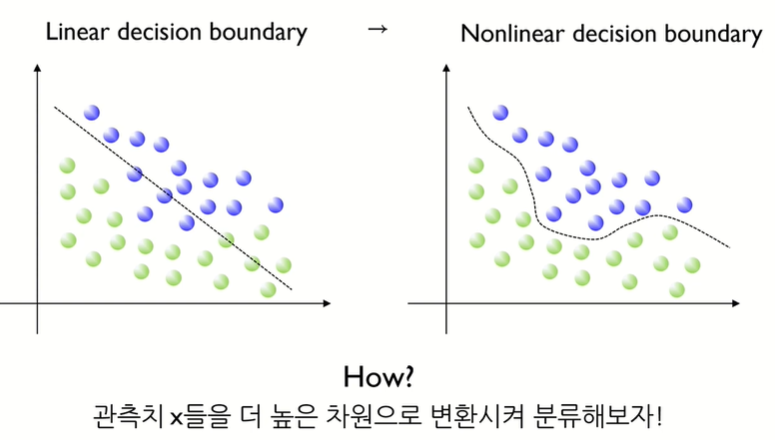

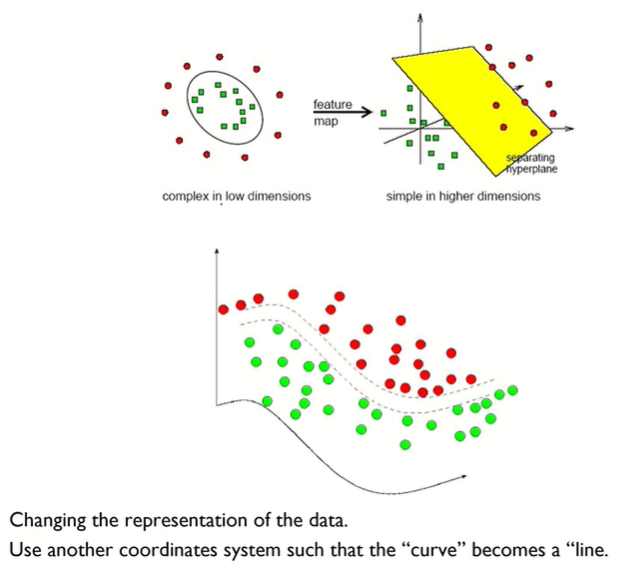

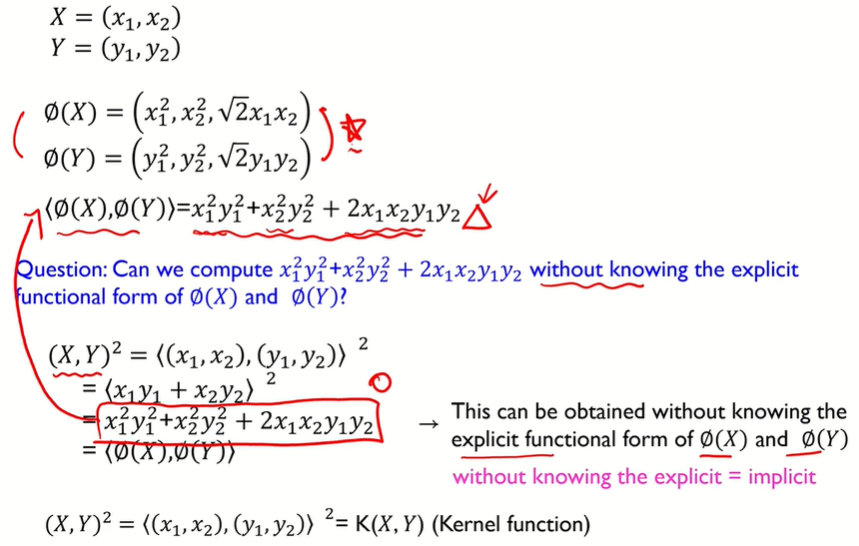

Kernel Methods for Nonlinear Classification

비선형

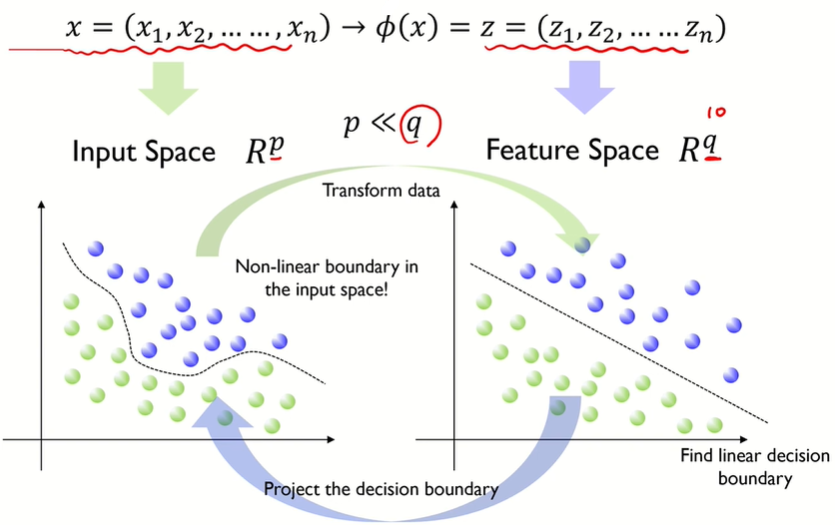

Transforming data

고차원으로 변환하여 선형SVM을 적용

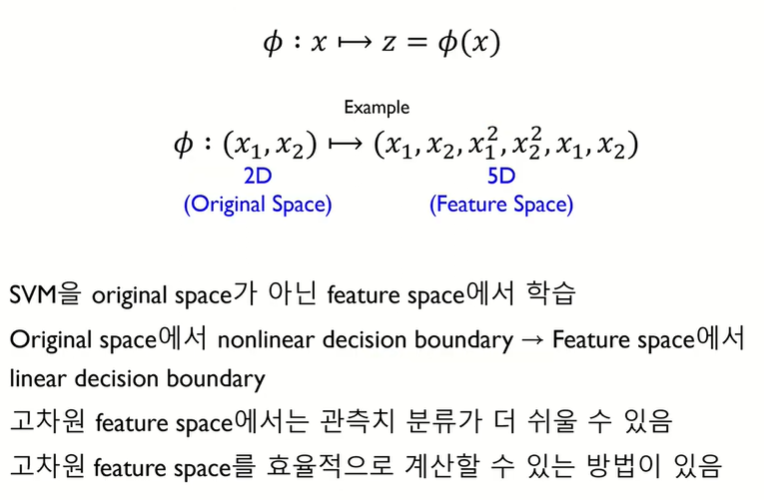

Mapping Original space to Kernel space

Φ를 고차원으로 바꿈

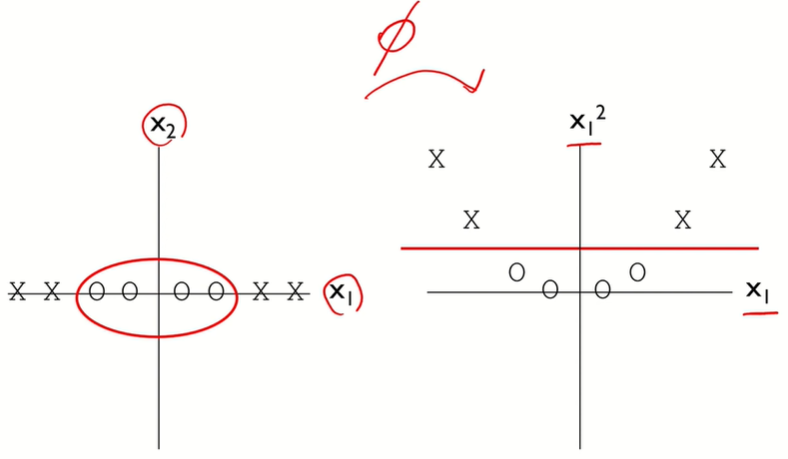

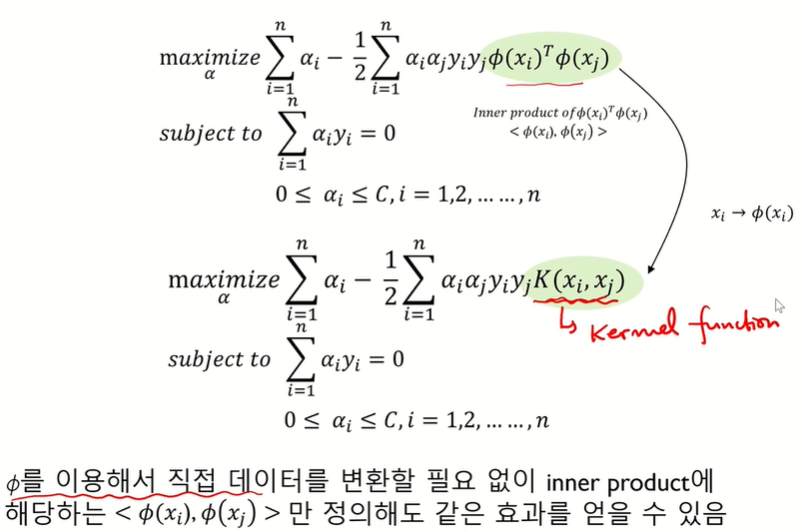

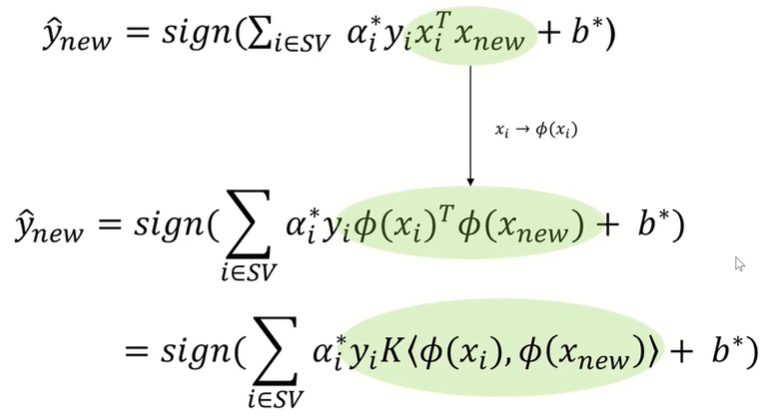

Kernel Mapping

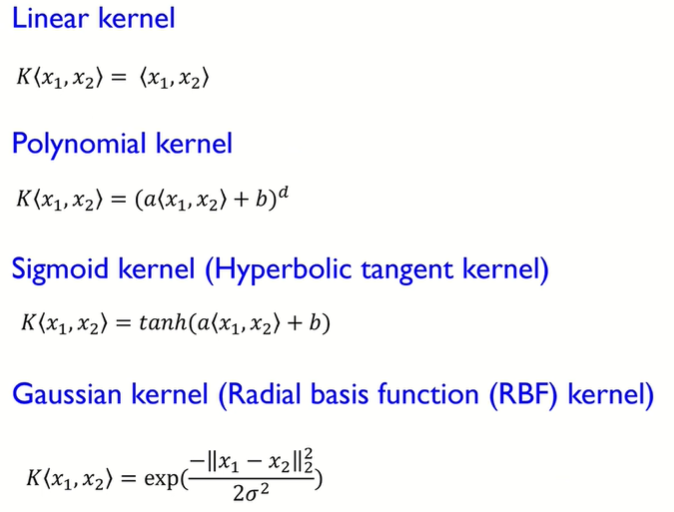

Kernel functions 종류

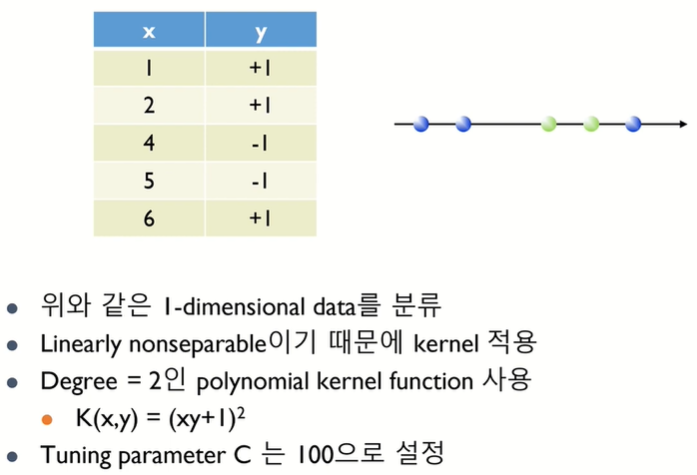

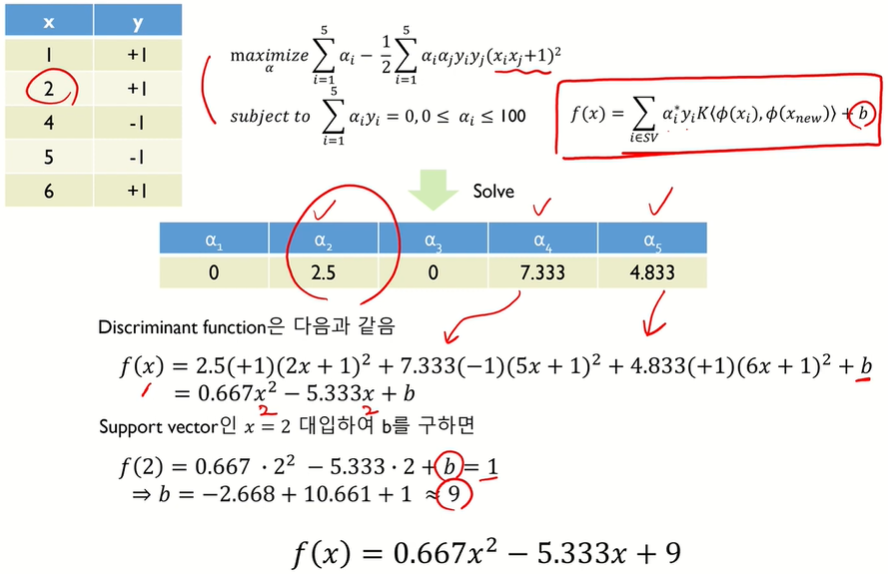

예제) kenel function을 이용한 비선형SVM

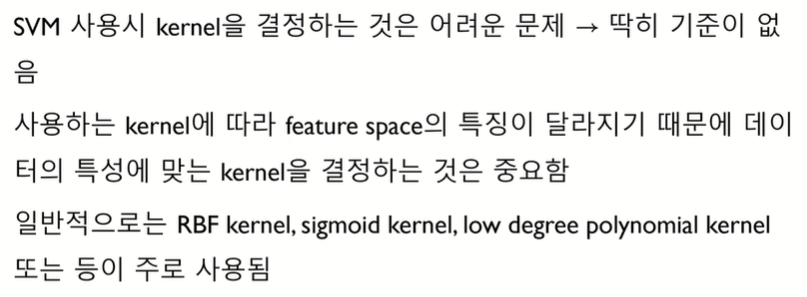

Kernel function 선택

잘맞는 kernel을 try and error로 찾아야 됨

polynomial은 4차 미만을 주로 사용

'Machine Learning' 카테고리의 다른 글

| 군집 분석 Clustering (0) | 2024.04.13 |

|---|---|

| PCA (Principal Component Analysis) (0) | 2024.04.13 |

| 랜덤포레스트 Random Forest (0) | 2024.04.13 |

| 의사결정나무 Decision Tree (0) | 2024.04.13 |

| KNN (K-Nearest Neighbor, K-최근접 이웃) (0) | 2024.04.13 |