1. 서론: '그림의 떡'이 된 ChatGPT와 기업의 엄중한 현실

ChatGPT, 클로드, 제미나이 등 혁신적인 대규모 언어 모델(LLM)이 비즈니스의 지형을 바꾸고 있습니다. 하지만 정작 국내 대기업이나 금융권 현장에서 이 기술들은 '그림의 떡'인 경우가 허다합니다. 가장 큰 장벽은 역시 보안과 개인정보 보호입니다.

"우리 회사 고객 데이터를 외부 API에 전송한다고요? 그건 불가능합니다. 사실상 불법이니까요."

이것은 단순히 보수적인 가이드라인의 문제가 아닙니다. 법무 및 보안팀의 시각에서 외부 가상 서버를 거치는 것조차 데이터 유출의 잠재적 통로로 간주됩니다. 혁신을 원하지만 데이터 주권을 포기할 수 없는 기업들에게, 대형 모델의 대안으로 부상한 SLM(Small Language Model, 소형 언어 모델)은 선택이 아닌 필수가 되고 있습니다.

--------------------------------------------------------------------------------

2. '고래'가 못 하는 일을 '새우'가 해낸다: 상호보완의 전략

흔히 LLM을 '고래', SLM을 '새우'에 비유합니다. 압도적인 성능을 자랑하는 고래는 웅장하지만, 기업 내부망이라는 폐쇄적이고 좁은 수조 안으로 들어올 수 없습니다. 반면, 1.5B(15억 파라미터) 수준의 날렵한 SLM은 로컬 환경에서도 충분히 구동 가능하며, 기업 고유의 맥락을 학습하는 데 탁월합니다.

특히 LG전자의 '워시타워(WashTower)'나 '워시콤보'와 같은 고유 브랜드명, 그리고 사내 전문 용어는 범용적인 LLM보다 특화 학습된 SLM이 훨씬 더 정교하게 이해합니다. 여기서 중요한 점은 SLM이 LLM을 대체하는 것이 아니라, LLM이 진화할수록 SLM도 함께 성장하는 공생 관계를 구축해야 한다는 것입니다.

"대형 LM 모델의 성능이 좋아지면 좋아질수록, 그 지식을 전수받아 SLM 연구도 같은 방향으로 발전해야 합니다. LLM이 못 하는 폐쇄적인 영역을 SLM이 완벽히 분리해서 담당해야 하죠."

--------------------------------------------------------------------------------

3. 양자화(Quantization): 모델 다이어트와 하드웨어의 함수 관계

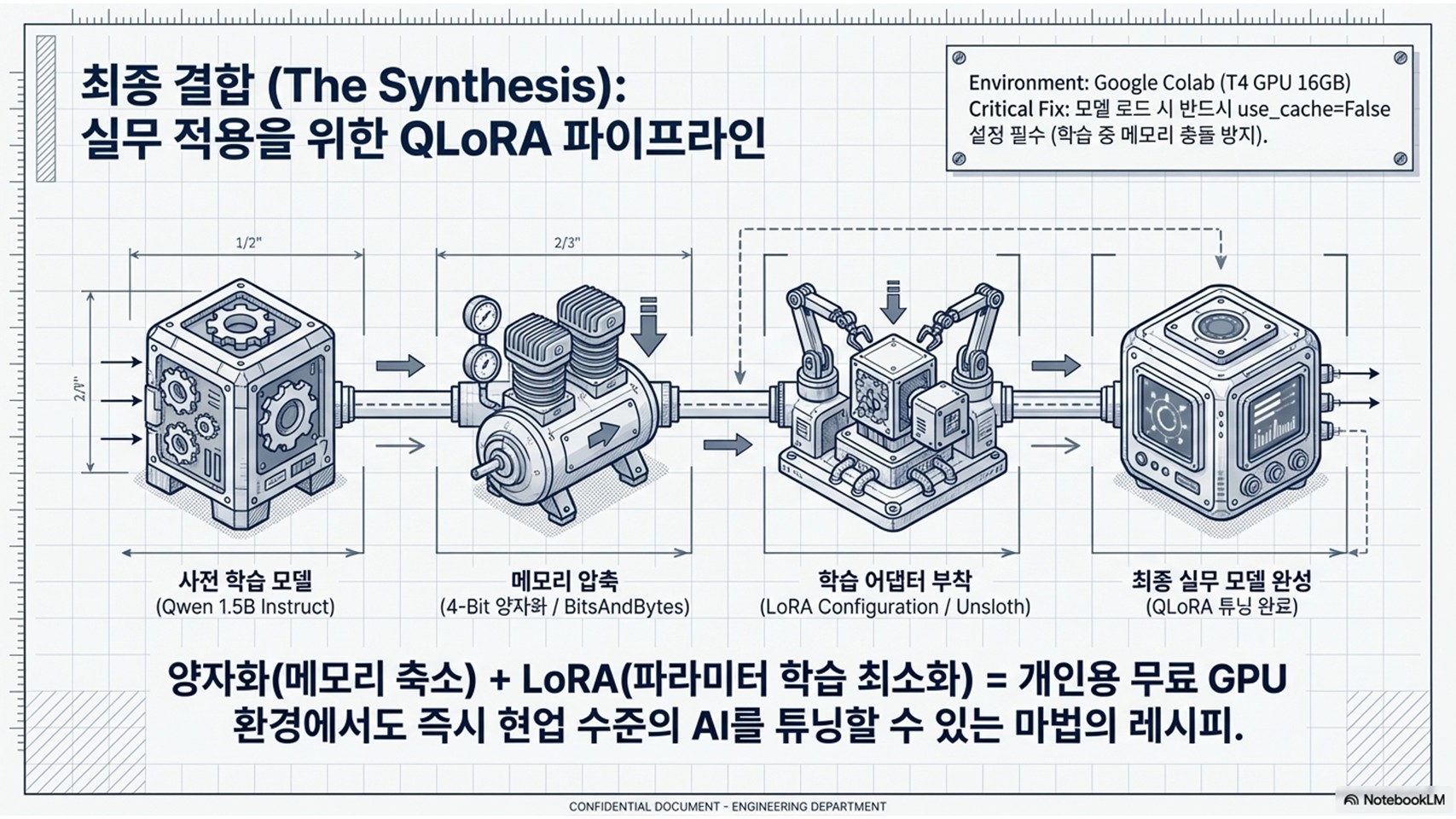

SLM을 기업 내부의 제한된 자원(예: 구글 콜랩 T4 GPU 등)에서 원활하게 돌리기 위해서는 양자화(Quantization) 기술이 핵심입니다. 이는 모델의 정밀도를 낮추어 연산 효율을 극대화하는 과정입니다.

쉽게 비유하자면, 복잡한 소수점 데이터인 '3.14159'를 '3'이라는 정수로 변환하여 표현하는 것과 같습니다. 이 과정을 통해 우리는 다음과 같은 실무적 이득을 얻습니다.

- 메모리 사용량의 획기적 감소: 모델 용량이 축소되어 로컬 환경에서도 구동 가능해집니다.

- 추론 속도 향상: 연산이 단순해짐에 따라 응답 속도가 비약적으로 빨라집니다.

- 전력 소비 및 비용 절감: GPU 자원 소모를 줄여 운영 비용을 최적화합니다.

실무적으로는 32비트(FP32) 모델을 **8비트(INT8)**로 변환하는 것이 표준입니다. 최근 4비트까지 낮추는 시도가 있으나, 이는 정보 손실이 매우 커 성능 저하가 심각할 수 있습니다. 특히 GPU(T4 등) 하드웨어 특성에 따라 성능 하락폭이 달라지므로, 반드시 정성적인 성능 지표를 확인하는 과정이 선행되어야 합니다.

--------------------------------------------------------------------------------

4. PEFT와 LoRA: '파멸적 망각' 없이 뇌를 업그레이드하는 법

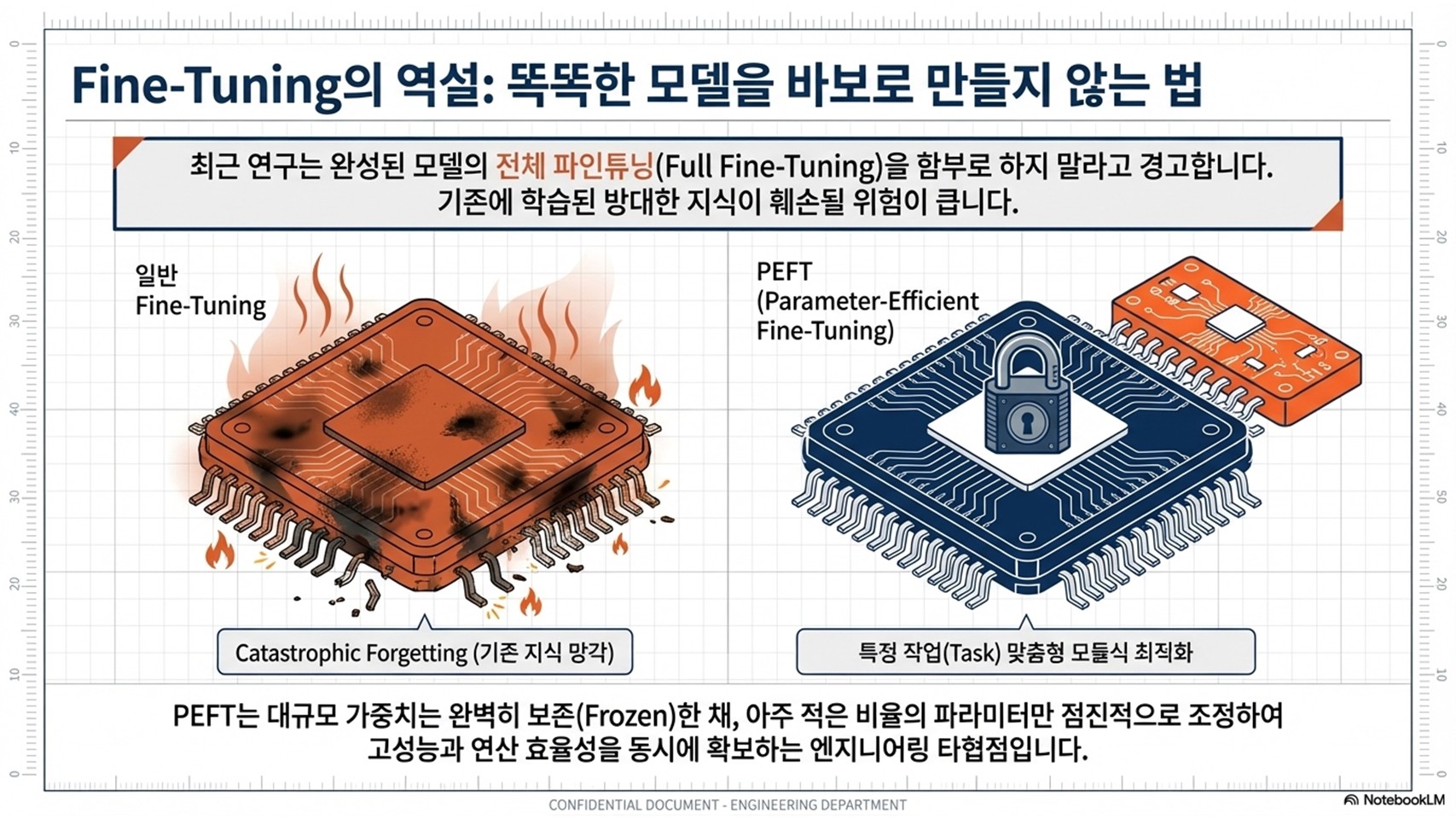

기업의 특수 목적에 맞춰 모델을 미세 조정(Fine-tuning)할 때, 가장 큰 리스크는 '파멸적 망각(Catastrophic Forgetting)'입니다. 새로운 지식을 배우려다 기존의 상식과 논리 구조를 잃어버리는 현상이죠.

이를 방지하기 위해 PEFT(Parameter-Efficient Fine-Tuning) 기법, 특히 로라(LoRA, Low-Rank Adaptation)를 활용합니다. LoRA는 모델의 전체 가중치를 수정하는 대신, 옆에 아주 작은 '저차원 행렬'만 추가하여 학습시킵니다. 기존의 거대한 뇌(사전 학습된 지식)는 그대로 둔 채, 특정 업무를 위한 '전문가 모듈'만 덧붙이는 셈입니다.

또한 이 과정에서 인베딩(Embedding), 즉 텍스트 데이터를 모델이 이해하는 최적의 숫자로 내제화하는 과정을 정교하게 조정함으로써, 모델이 기업 데이터를 단순 암기하는 것이 아니라 그 맥락을 숫자의 공간 안에 정확히 배치하게 만듭니다.

--------------------------------------------------------------------------------

5. 실전 적용 사례: 보안의 게이트키퍼와 특수 페르소나

SLM이 현업에서 즉시 가치를 창출하는 시나리오는 매우 구체적입니다.

- 사례 1: 민감 정보 마스킹 (The Gatekeeper) 고객 상담 데이터(이름, 전화번호, 주소 등)는 보안망 밖으로 나갈 수 없습니다. SLM은 법무/보안팀이 승인할 수 있는 형태로 데이터를 비식별화하는 '필수 관문' 역할을 수행합니다. 내부에서 SLM이 정보를 가려준 뒤에야 비로소 데이터를 분석하거나 외부로 반출할 수 있는 법적 근거가 마련됩니다.

- 사례 2: 거친 말투 및 특수 페르소나 생성 범용 API 모델은 윤리 가이드라인에 따라 거친 언어나 편향된 어조 생성이 제한됩니다. 하지만 악성 민원 대응 훈련이나 특수 상황 시뮬레이션이 필요한 경우, 기업은 로컬 SLM을 통해 일반 모델로는 불가능한 독특한 페르소나를 구현하여 학습 데이터를 생성할 수 있습니다.

"세상에 데이터는 넘쳐나지만, AI 학습에 적합한 '양질의 데이터'를 만드는 것은 전혀 다른 차원의 실력입니다."

--------------------------------------------------------------------------------

6. 결론: 온디바이스 AI 시대, 기업 데이터 주권의 열쇠

결국 SLM은 개인 디바이스와 기업의 폐쇄망 안에서 AI를 자유롭게 활용하기 위한 핵심 열쇠입니다. 모든 기업이 수조 원을 들여 거대 모델을 직접 만들 필요는 없습니다. 오히려 우리 회사만의 '비밀'을 완벽하게 지키면서, 전문적인 업무를 묵묵히 수행하는 똑똑한 1.5B급 모델 하나가 수백억 원의 비즈니스 가치를 창출합니다.

성능은 조금 낮더라도 우리 회사의 데이터 주권을 완벽히 지켜주는 AI, 온디바이스 AI 시대의 진정한 승자는 거대한 고래를 다루는 자가 아니라, 작지만 강력한 SLM을 제어하는 자가 될 것입니다.

'LLM' 카테고리의 다른 글

| Edge SLM FineTune Engineering (0) | 2026.03.30 |

|---|---|

| Fine-Tuning Llama 3.1 with Unsloth (0) | 2026.03.30 |

| LLM의 학습 데이터 (0) | 2026.01.27 |

| Embedding 예제 (0) | 2026.01.27 |

| Tokenization, Vectorization and Embedding (0) | 2026.01.26 |